AI is niet meer weg te denken uit onze samenleving. In het onderwijs, de zorg en het sociaal domein worden algoritmes en slimme toepassingen steeds vaker ingezet om processen te versnellen, data beter te benutten en professionals te ondersteunen. Maar er is ook een keerzijde. Fouten of ondoordachte keuzes kunnen leiden tot discriminatie, verlies van vertrouwen of zelfs maatschappelijke schade. Denk aan de toeslagenaffaire, waar algoritmische besluitvorming duizenden gezinnen in de problemen bracht.

In ons artikel over de AI Act lieten we zien wat organisaties wettelijk moeten regelen. In dit artikel laten we zien hoe je dat vertaalt naar een breder governance-raamwerk waarmee je écht strategische waarde haalt uit AI.

Governance klinkt misschien als iets voor juristen of beleidsmakers, maar in feite gaat het over één ding: hoe zorg je ervoor dat AI verantwoord, eerlijk en toekomstbestendig wordt toegepast, zodat jouw organisatie er zonder problemen de vruchten van kan plukken?

In dit artikel laten we zien wat AI governance inhoudt, waarom het nú urgent is, welke bouwstenen onmisbaar zijn en hoe je als organisatie stap voor stap volwassen kunt worden in AI governance.

Wat verstaan we onder AI governance?

AI governance is het raamwerk van regels, processen en instrumenten waarmee je grip houdt op de inzet van AI. Het gaat verder dan alleen compliance of ethiek. Goede AI governance zorgt ervoor dat technologie aansluit bij de strategie, waarden en maatschappelijke verantwoordelijkheid van je organisatie.

Het verschil met andere vormen van governance (zoals IT- of datagovernance) zit hem in de aard van AI zelf. Traditionele IT volgt regels en logica die door mensen zijn vastgesteld. AI leert, past zich aan en kan zelf verbanden leggen die voor mensen ondoorzichtig zijn. Dat maakt toezicht, verantwoording en transparantie extra belangrijk én complex.

Waarom AI governance juist nú urgent is

De urgentie is duidelijk en drievoudig:

- AI is mainstream. 79% van organisaties ziet AI als cruciaal voor succes in de komende twee jaar (Gartner, 2023). Daarnaast kunnen veel (publieke) organisaties er ook niet omheen, omdat een groot deel van hun eigen doelgroep het ook gebruikt.

- De risico’s zijn groot. Van bias en discriminatie tot ondoorzichtige ‘black box’-beslissingen die professionals of burgers direct kunnen raken.

- De wetgever kijkt mee. De AVG/GDPR geldt al, maar vanaf 2026 hebben we te maken met de AI Act: de eerste Europese wet die specifiek AI-systemen reguleert. Organisaties in zorg, onderwijs en sociaal domein moeten hier nu al op voorsorteren.

Kortom: AI governance is geen luxe of nice-to-have. Het is een randvoorwaarde voor verantwoord werken én voor het behouden van legitimiteit als publieke of maatschappelijke organisatie.

De vijf bouwstenen van AI governance

AI governance kun je zien als een huis dat rust op vijf stevige pijlers. Samen vormen ze het fundament om AI verantwoord in te zetten. De bouwstenen die we hier bespreken zorgen ervoor dat je de minimale verplichtingen uit de AI Act structureel kunt borgen in je organisatie, en zelfs nog een stap verder kunt gaan in het strategisch en verantwoord inzetten van AI.

1. Ethiek & Verantwoord gebruik

De kern van AI governance begint met ethiek. Hoe zorg je dat AI transparant, eerlijk en uitlegbaar is? Belangrijke elementen zijn:

- Transparantie: inzichtelijk maken hoe een algoritme tot een besluit komt (en voorkomen dat het een black box is).

- Accountability: iemand moet verantwoordelijk zijn voor beslissingen die met AI zijn genomen.

- Menselijk toezicht: er moet altijd ruimte zijn voor menselijke inbreng, zeker bij beslissingen die levens raken.

Zo voorkom je bijvoorbeeld dat een algoritme dat leerlingprestaties voorspelt, systematisch te hoge verwachtingen blijkt te vormen over leerlingen met een westerse achtergrond, waardoor zij de ondersteuning die ze nodig hebben niet (of te laat) krijgen.

2. Stakeholderimpact

AI raakt méér dan de directe gebruiker van een tool. Denk aan leerlingen en ouders, patiënten en hun families, of burgers die afhankelijk zijn van gemeentelijke ondersteuning. Zelfs als zij niet zelf met een systeem werken, dan kan het nog wel zo zijn dat hun informatie door het systeem wordt verwerkt of dat het systeem zelfs beslissingen maakt (of adviezen geeft) die hen kunnen raken.

Governance betekent dus ook nadenken over:

- Impact op directe stakeholders: hoe ervaren medewerkers, klanten en partners de inzet van AI?

- Impact op de samenleving: sluit je toepassing aan bij bredere maatschappelijke waarden, of loop je risico dat je het publieke vertrouwen schaadt?

Voorbeeld: een AI-systeem adviseert jeugdzorgmedewerkers bij risicotaxaties. Het systeem is getraind op historische casussen waarin jongeren uit gebroken gezinnen oververtegenwoordigd waren. Het gevolg: nieuwe meldingen van kinderen met een vergelijkbare achtergrond krijgen systematisch een hoger risicoscore. Dat leidt tot overmatige bemoeienis en stigma, terwijl andere kwetsbare groepen onder de radar blijven.

3. Datakwaliteit & Privacy

Het nut van AI staat of valt met data. Klopt die data wel? Waar komt die vandaan? Wat mag daar wel en niet mee gebeuren? Governance vraagt daarom om robuuste processen rondom:

- Datavalidatie: kloppen de brondata, zijn ze compleet en representatief?

- Privacy-assessment: hoe zorg je dat persoonsgegevens volgens de AVG worden verwerkt, bijvoorbeeld met een DPIA (Data Protection Impact Assessment)?

Denk bijvoorbeeld aan een ziekenhuis dat een AI-algoritme traint op historische patiëntdata, maar de dataset bevat verouderde of foutieve gegevens. Of de gegevens zijn om een andere (demografische) reden niet representatief voor de patiëntpopulatie van het ziekenhuis. Het systeem kan daardoor verkeerde behandeladviezen geven. En zelfs als de data wel kloppen: wie kan die dan allemaal opvragen en wat kunnen zij precies zien?

4. Risicobeheersing & Evaluatie

AI-systemen veranderen en leren voortdurend. Governance moet daarom dynamisch zijn:

- Continue risico-assessments: niet eenmalig bij start, maar bij elke update of nieuwe dataset.

- Externe audits en evaluaties: betrek onafhankelijke partijen om de kwaliteit en

Zo voorkom je bijvoorbeeld een scenario waarin een hogeschool AI implementeert om plagiaat te detecteren, maar de tool nooit evalueert. Nieuwe vormen van AI-gegenereerde teksten (worden daardoor niet herkend. Tegelijkertijd zijn mensen door veelvuldig gebruik van AI misschien zelf meer gaan schrijven zoals ChatGPT (door bijvoorbeeld – vaker streepjes te gebruiken). Studenten die frauderen glippen erdoorheen, terwijl anderen onterecht beschuldigd worden.

5. Compliance

Tot slot moet je natuurlijk voldoen aan de wettelijke kaders. Dat betekent:

- Voor 2026 al: voldoen aan de AVG/GDPR en verplichte AI-geletterdheid.

- Vanaf 2026: voorbereid zijn op de AI Act, met strengere regels voor hoog-risico AI-toepassingen.

Er zal niet direct hele strenge handhaving op zijn, maar als er dingen fout gaan zijn de juridische consequenties groot. Stel: een woningbouwcorporatie zet een algoritme in voor voorspellend onderhoud van woningen in kwetsbare wijken, maar voldoet niet aan de GDPR-vereisten rond persoonsgegevens. Of woningen in zeer slechte staat worden per ongeluk niet geselecteerd door het systeem. Dat kan leiden tot boetes, als blijkt dat je in strijd hebt gehandeld met geldende wetgeving.

Samen vormen deze vijf bouwstenen een integraal raamwerk dat organisaties helpt AI verantwoord te laten landen.

Hoe volwassen is jouw AI governance?

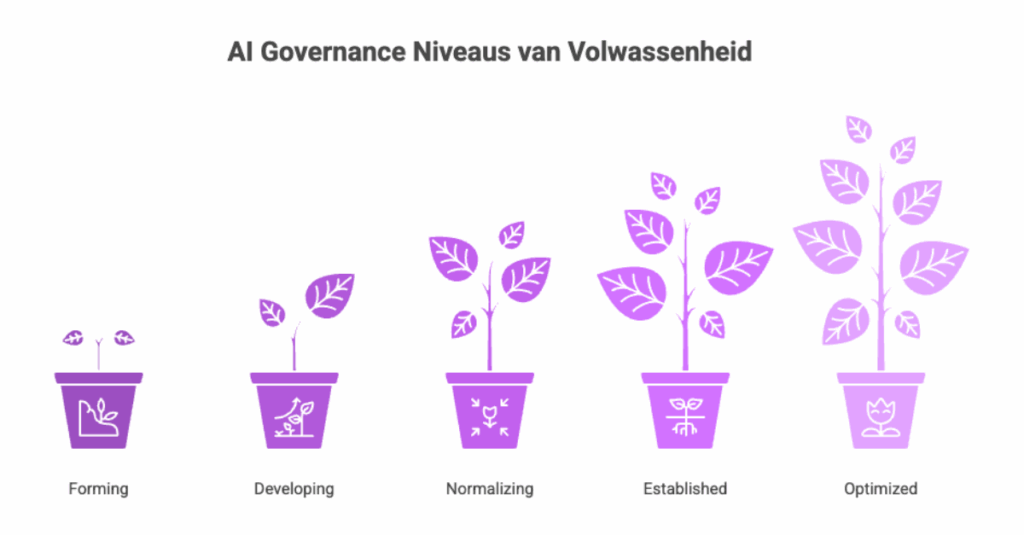

Net zoals organisaties groeien in hun digitale volwassenheid, kun je ook kijken naar de volwassenheid van AI governance. Daar heeft een van onze oprichters op basis van wetenschappelijk onderzoek een AI Governance Maturity Model (AGMM) voor ontwikkeld. Dit model onderscheidt vijf niveaus:

- Forming: eerste initiatieven, veel ad hoc.

- Developing: basisprocessen ingericht, verantwoordelijkheden belegd.

- Normalizing: governance wordt onderdeel van de dagelijkse praktijk.

- Established: breed gedragen, goed geborgd in processen en cultuur.

- Optimized: continu verbeteren en innoveren, proactief omgaan met nieuwe risico’s en technologie.

Je meet je volwassenheid op elk van de vijf bouwstenen van AI governance. Zo kan het zijn dat een organisatie op het gebied van datakwaliteit en privacy al heel ver is, maar dat ethiek en verantwoord gebruik nog in de kinderschoenen staat.

Met dit model kunnen organisaties niet alleen vaststellen waar ze nu staan, maar ook bepalen wat voor hen een logisch niveau is om naar te streven (niet iedere organisatie hoeft op alle bouwstenen niveau 5 te halen) en een routekaart opstellen voor verdere ontwikkeling.

Wat betekent dit concreet voor onderwijs, zorg en sociaal domein?

Voor onze sectoren (waar het werk direct aan mensen en de samenleving raakt) zijn de risico’s én de kansen groot. Een paar voorbeelden:

- Onderwijs: AI kan helpen bij het personaliseren van leertrajecten. Maar wat als het algoritme bevooroordeeld is en bepaalde leerlingen structureel te laag (of te hoog) inschat? In termen van governance vraagt dat om veel transparantie, toetsing en correctie.

- Zorg: algoritmes kunnen psychologen ondersteunen bij diagnoses en behandelplannen. Maar wie is verantwoordelijk als de aanbeveling fout blijkt te zijn? Belangrijke governance vraagstukken hier gaan over duidelijke accountability en menselijk toezicht.

- Sociaal domein: gemeenten kunnen AI inzetten bij uitkeringsverstrekking of schuldhulpverlening. Dat vraagt sterk om ethische toetsing: schaad je niet onbedoeld juist de kwetsbaarste groepen?

Bestuurders en projectleiders zouden zichzelf bij hun ambities en AI-projecten minimaal drie vragen moeten stellen:

- Hebben we een ethische toets of commissie die meekijkt?

- Zijn onze data en processen aantoonbaar eerlijk en transparant?

- Weten we wie er verantwoordelijk is voor beslissingen waarbij AI een rol speelt?

Van theorie naar praktijk: hoe begin je?

Het inrichten van AI governance hoeft niet ingewikkeld te zijn. Sterker nog, klein beginnen levert vaak het meeste resultaat. Enkele praktische stappen:

- Creëer bewustwording. Organiseer een sessie waarin je uitlegt wat AI governance is en waarom het belangrijk is.

- Leg rollen vast. Wijs één of meerdere verantwoordelijken aan voor AI-governance (denk aan een privacy officer of projectleider AI).

- Start met quick wins. Voer DPIA’s en FRIA’s uit voor de belangrijkste AI-tools waar in je organisatie gebruik van wordt gemaakt. Leg vast welke stakeholders geraakt worden, en zorg dat er een mens verantwoordelijk blijft voor AI-beslissingen. Zet ook direct in op AI-geletterdheid, want dat is sinds februari 2025 al verplicht.

- Maak governance concreet. Gebruik checklists, formats en ons maturity model om stappen zichtbaar te maken.

- Leer en verbeter. Zie governance niet als extra bureaucratie, maar als middel om sneller draagvlak en vertrouwen te krijgen. En dus ook echt verantwoord te kunnen profiteren (betere kwaliteit, meer efficiency, etc.) van de kansen die AI biedt!

Conclusie

AI governance is geen stoffig beleidsdocument of juridische verplichting. Het is de sleutel om AI verantwoord, eerlijk en toekomstbestendig te gebruiken.

Organisaties die vandaag beginnen, plukken morgen al de vruchten: meer vertrouwen van stakeholders, minder risico’s, betere naleving van wetgeving en vooral: meer ruimte om met AI maatschappelijke impact te maken.

Bij Brighthives helpen we organisaties in onderwijs, zorg en het sociaal domein om die stap te zetten. Van een eerste bewustwordingssessie tot het uitvoeren van een volwassenheids-assessment en het ontwikkelen van een groeipad. Zodat je niet alleen voldoet aan wetgeving, maar vooral ook AI inzet op een manier die past bij jouw waarden en maatschappelijke opdracht.

Wil je hier hulp bij? Neem dan contact met ons op. Hoe je dit handig opzet hangt af van verschillende factoren (waaronder de manier waarop governance rond IT en IM nu al is georganiseerd) en vraagt dus om maatwerk.